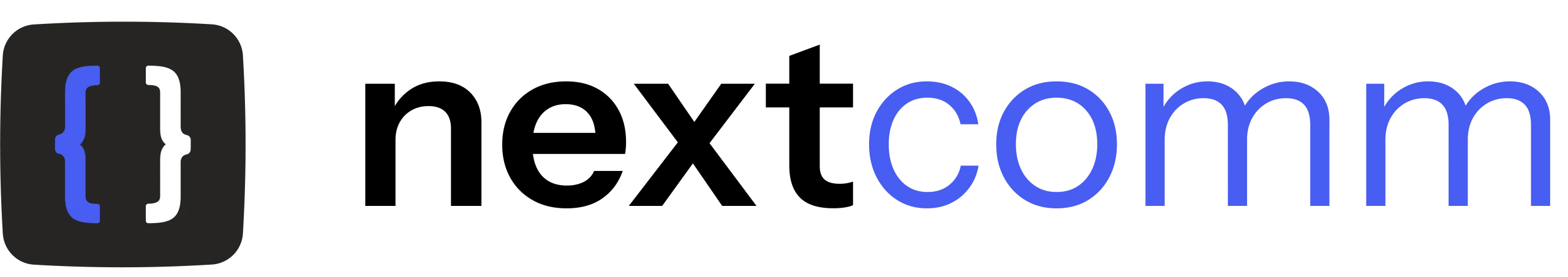

A inteligência artificial está sendo adotada em ritmo acelerado nas organizações, e a maior parte das discussões sobre o tema oscila entre dois extremos: a IA como solução para tudo ou a IA como ameaça a ser temida. Ambas as perspectivas são imprecisas. O que gestores precisam, na prática, é de uma distinção clara entre dois tipos fundamentais de aplicação: a IA que toma decisão de forma autônoma, e a IA que apoia a decisão humana. Esse entendimento define onde a tecnologia agrega valor estratégico, e onde ela ainda depende de supervisão qualificada.

A IA autônoma: onde a velocidade e o volume justificam a autonomia

A IA autônoma é aquela que opera sem intervenção humana em cada transação. Ela recebe um input (entrada de dados), processa e executa uma ação dentro de regras pré-definidas. Esse modelo é altamente eficaz em situações que combinam alto volume, baixa ambiguidade e necessidade de resposta imediata.

Exemplos típicos incluem:

- Detecção de fraude em tempo real, onde o sistema bloqueia uma transação suspeita antes que ela seja processada

- Roteamento de chamadas e atendimentos, direcionando cada solicitação para o canal ou agente mais adequado

- Precificação dinâmica, ajustando valores com base em demanda e comportamento do mercado

- Triagem de tickets de suporte, categorizando e priorizando demandas sem intervenção manual

Nessas aplicações, a intervenção humana em cada decisão seria, além de ineficiente, impossível dada a escala. O papel do gestor é definir as regras, auditar os resultados e ajustar os parâmetros quando necessário.

A IA como copiloto: onde o julgamento humano é insubstituível

Por outro lado, há uma categoria de decisões onde a IA agrega valor como suporte, mas onde a autonomia total é inadequada. São decisões que envolvem alto risco, ambiguidade ética, consequências de longo prazo ou a necessidade de inteligência cultural e emocional.

Nessas situações, a IA atua como um copiloto. Ela analisa grandes volumes de dados, identifica padrões que escapariam ao olho humano e modela cenários alternativos. Mas a decisão final permanece com o gestor.

Exemplos dessa categoria incluem decisões de fusão e aquisição, reestruturações organizacionais, definição de estratégia de longo prazo e gestão de crises com forte componente reputacional. Nenhum modelo de IA possui o contexto completo, a responsabilidade institucional e a inteligência social necessários para conduzir essas decisões de forma autônoma.

O risco de confundir as duas categorias

Quando uma organização aplica IA autônoma em decisões que exigem julgamento humano, o resultado pode ser problemático. Sistemas de recrutamento automatizados que reproduzem vieses históricos, modelos de crédito que discriminam grupos vulneráveis e algoritmos de conteúdo que amplificam informações incorretas são exemplos reais desse erro.

Por outro lado, quando gestores resistem ao uso de IA como suporte em decisões onde ela claramente agrega valor, a consequência é uma liderança mais lenta, mais sujeita a erros cognitivos e menos capaz de processar a complexidade dos dados disponíveis.

A distinção entre os dois modelos não é apenas técnica. É uma questão de governança e de alfabetização em inteligência artificial por parte da liderança.

Como desenvolver a alfabetização em IA como competência de gestão

A alfabetização em IA é a capacidade de entender o que os sistemas de inteligência artificial fazem, quais são seus limites e como governá-los de forma eficaz. Ela está se tornando uma competência essencial para líderes em qualquer setor.

Não se trata de saber programar ou de entender os detalhes técnicos dos modelos. Trata-se de saber fazer as perguntas certas:

- Em quais dados esse modelo foi treinado, e quais vieses eles podem conter?

- Quais são os critérios que o sistema usa para tomar essa decisão?

- Como o desempenho do modelo é monitorado ao longo do tempo?

- Quem é responsável quando o sistema erra?

Gestores que sabem responder a essas perguntas conseguem usar a IA de forma estratégica, sem abdicar da supervisão e do julgamento que a liderança exige.

A IA como multiplicadora do discernimento humano

A inteligência artificial não substitui a liderança. Ela a multiplica. Quando bem implementada, ela expande a capacidade do gestor de processar informações, identificar riscos e modelar cenários, sem eliminar a responsabilidade pelo julgamento final.

A distinção entre a IA que toma decisão e a IA que apoia decisão é, no fundo, uma questão de consciência sobre o que a tecnologia pode e o que ela não deve fazer. Organizações que fazem essa distinção com clareza usam a IA para crescer com mais inteligência. As que não fazem correm o risco de delegar para máquinas o que apenas humanos podem, e devem, decidir.

Serviço

Nextcomm – criamos soluções de comunicação que transformam a maneira como as empresas se conectam e interagem.

nextcomm.com.br

Instagram: @nextcommoficial

Telefone: 0800-765-1558

E-mail: contato@nextcomm.com.br